توانایی استدلال کردن، بیان کردن استدلال ما به دیگران، یکی از ویژگی های تعریف کننده آن چیزی است که باید انسان باشد.

بحث و گفتگو، سنگ بنای جامعه متمدن و زندگی فکری را تشکیل می دهد. فرایندهای استدلال دولت های ما را اجرا می کنند، ساختار تلاش های علمی و ساختار باور مذهبی را ایجاد می کنند. بنابراین باید نگرانی داشته باشیم که پیشرفت های جدید در هوش مصنوعی گام هایی در جهت تجهیز کامپیوتر به این مهارت ها می دهد؟

به عنوان تکنولوژی زندگی ما را تغییر می دهد، ما همه به روش های جدید کار و روش های جدید تعامل استفاده می شود. هزارهها هیچ چیز دیگری را نمیدانند دولت ها و قوه قضاییه از توان بالقوه ارائه شده توسط تکنولوژی برای جذب شهروندان در روند دموکراتیک و قانونی استفاده می کنند. بعضی از سیاستمداران، به طور جداگانه، در درک نقش عظیمی که رسانه های اجتماعی در روند انتخابات نقش دارند، بیشتر از این بازی است. اما چالش های زیادی وجود دارد.

یکی از زیبایی هاست Upworthy مدیرعامل الی پاریزر در بحث TED خود. در آن، او توضیح می دهد که چگونه ما شروع به «حباب های فیلتر» می کنیم: آنچه که می بینید وقتی که یک عبارت معین را در Google جستجو می کنید، لزوما همان چیزی نیست که من می بینم وقتی که من همان معنی را جستجو می کنم. سازمان های رسانه ای از Fox News تا اخیرا بی بی سی، محتوای شخصی را شخصی سازی می کنند، با شناسه و ورود به سیستم برای انتخاب داستان هایی که بیشترین اهمیت را دارند، استفاده می شود. نتیجه این است که ما در معرض خودمان قرار می گیریم تا در اتاق های اکو افراد مبتلا به همبستگی قرار گیریم، در حالی که استدلال های ما یکپارچه، کمتر متعادل و کمتر درک از دیدگاه های دیگر است.

{youtube}https://youtu.be/4w48Ip-KPRs{/youtube}

TED / یوتیوب

چرا تفکر انتقادی حیاتی است

یکی دیگر از نگرانی ها این است که چگونه اخبار و اطلاعات، هرچند که بیشتر از حد زیاد است، کمتر قابل اعتماد هستند - اتهامات و متهم کردن "اخبار جعلی"اکنون شایع است.

در مقابل چنین چالش هایی، مهارت های تفکر انتقادی در حال حاضر حیاتی تر از گذشته است - توانایی قضاوت و ارزیابی شواهد به سرعت و کارآمد، گام برداری در خارج از اتاق اکو ما و فکر کردن در مورد چیزها از دیدگاه های دیگر، به یکپارچه سازی اطلاعات، اغلب در تیم ها، استدلال های توجیه را در هر دو طرف به توافق می رسانند و نتیجه های محکم و قابل دفاع را به دست می آورند. اینها مهارتهای استدلالی است که از تحقیقات علمی در فلسفه برای بیش از 2,000 سال، از زمان ارسطو، بوده است.

La مرکز تکنولوژی Argument (ARG-tech) در دانشگاه داندی همه چیز مربوط به پذیرش و توسعه نظریه های فلسفه، زبان شناسی و روانشناسی است که به ما می گوید که چگونه انسان ها بحث می کنند، چگونه آنها مخالفند و چگونه آنها به توافق برسند - و این نظریه ها را نقطه شروع برای ساختن ابزار هوش مصنوعی که مدل، تشخیص، آموزش و حتی در بحث های انسانی شرکت می کند.

یکی از چالش های تحقیق مدرن در این منطقه داده های کافی به دست آمده است. تکنیک های AI مانند یادگیری عمیق نیاز به مقادیر زیادی از داده ها، نمونه های با دقت بررسی شده است که می تواند به ایجاد الگوریتم های قوی کمک کند.

اما گرفتن چنین اطلاعاتی واقعا دشوار است: ساعتها کار سخت و دشواری را برای تحلیلگران به کار میگیرد تا از چند دقایق گفتوگو جدا شود.

بیش از 10 سال پیش، ARG-tech به برنامه بی بی سی 4 تبدیل شد پیچ و خم اخلاق، به عنوان نمونه ای از بحث "طلا-استاندارد": استدلال دقیق و دقیق در مورد مسائل احساسی، موضعی، با اعتدال دقیق و اندازه گیری شده. به شدت ارزشمند است که داده ها توسط یک برنامه تحقیق تجربی مبتنی بر فن آوری استدلال تغذیه می شود.

تکنولوژی

کار با چنین داده های طلبکارانه به این معنی بوده است که همه چیز ، از نظریه فلسفی گرفته تا زیرساخت داده های مقیاس بزرگ ، مورد آزمایش قرار گرفته است. در اکتبر 2017 ، ما یک خلبان را با دپارتمان اخلاق و اخلاق رادیوی بی بی سی اجرا کردیم تا دو نوع فن آوری جدید بحث کنیم.

اول مجموعه ای از "تجزیه و تحلیل" بود. ما با ساختن یک نقشه عظیم از هر مضمون اخلاقی آغاز کردیم، که شامل هزاران سخنرانی فردی و هزاران ارتباط دیگر بین محتویات این سخنان است. هر نقشه پس از آن به یک مجموعه از infographics ترجمه شد، با استفاده از الگوریتم ها برای تعیین بیشتر تم های مرکزی (با استفاده از چیزی شبیه به گوگل رتبه صفحه الگوریتم) ما به طور خودکار بیشترین مسائل جدایی ناپذیر را شناسایی کردیم و در آن شرکت کنندگان ایستادند، و همچنین لحظاتی در بحث زمانی که مناقشه به نقطه جوش رسید، استدلال هایی که به خوبی پشتیبانی شده بودند، و غیره.

نتیجه، در bbc.arg.tech در رابطه با Maze اخلاقی، برای اولین بار، یک روش مبتنی بر شواهد برای فهمیدن آنچه واقعا در یک بحث اتفاق می افتد، ارائه می دهد.

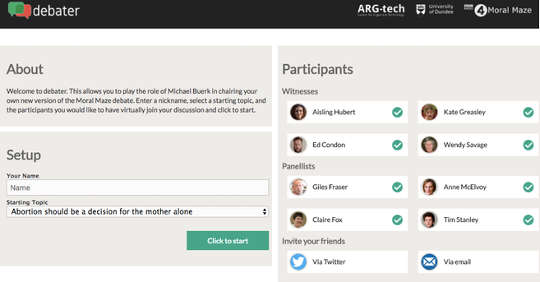

دوم ابزاري بود به نام "داوری"، که اجازه می دهد تا شما را به نقش صندلی پیچ و خم اخلاق و اجرای نسخه خود را. استدلال های ارائه شده توسط هر شرکت کننده طول می کشد و به شما اجازه می دهد آنها را به دنبال، به دنبال بینی خود برای استدلال خوب.

ابزار بحث و گفت و گو اجازه می دهد تا شرکت کنندگان بحث و بررسی مهارت های خود را. بی بی سی / دانشگاه دانندی ARG-tech

هر دو جنبه به ارائه بینش و تشویق کیفیت بهتر، استدلال بازتاب بیشتر. یک دست، کار اجازه می دهد خلاصه از چگونگی بهبود مهارت های استدلال، بر اساس شواهد موجود در داده ها از آنچه در واقع کار می کند.

از سوی دیگر، فرصتی است که به طور صریح به این مهارتها آموزش دهد: الف تست argument شما نمونه اولیه مستقر در سایت بی بی سی طرز استفاده از نمونه هایی از مازی اخلاقی برای کشف تعداد کمی از مهارت های استدلال و اجازه می دهد تا عقلانیت خود را به طور مستقیم در برابر ماشین بشوید.

تلاش تیمی

در نهایت، هدف این نیست که ما یک ماشین بسازیم که بتواند ما را در استدلال شکست دهد. خیلی هیجان انگیز است که توانایی استفاده از نرم افزار AI را در بحث های انسانی دارد - شناسایی نوع استدلال، انتقاد از آنها، ارائه دیدگاه های متداول و علل پروب کردن، همه چیزهایی هستند که اکنون در دسترس هستند.

و این در اینجا است که ارزش واقعی دروغ است - با داشتن تیم هایی از طرفداران، برخی از انسان ها، برخی از ماشین ها، با یکدیگر کار می کنند تا با شرایط سخت و پیچیده ای از تجزیه و تحلیل اطلاعات به مدیریت کسب و کار برخورد کنند.

![]() چنین گروه های مشورتی مشارکتی، "مخلوط ابتکاری" قصد دارند به شیوه ای که ما در مورد تعامل با AI فکر می کنند را تغییر دهند - و امیدواریم توانایی های استدلال جمعی ما را نیز تغییر دهیم.

چنین گروه های مشورتی مشارکتی، "مخلوط ابتکاری" قصد دارند به شیوه ای که ما در مورد تعامل با AI فکر می کنند را تغییر دهند - و امیدواریم توانایی های استدلال جمعی ما را نیز تغییر دهیم.

درباره نویسنده

کریس رید، استاد علوم کامپیوتر و فلسفه، دانشگاه داندی

این مقاله در اصل در تاریخ منتشر شد گفتگو. دفعات بازدید: مقاله.

کتاب های مرتبط:

at InnerSelf Market و آمازون